Facebook veröffentlicht seinen KI-Renderalgorithmus DeepFocus als Open Source, um freien Zugang zur Software zu ermöglichen. Das Renderverfahren ist in der Lage, natürlich wirkende Unschärfe in Echtzeit zu erzeugen und dadurch ein deutlich realistischeres visuelles Bild der VR zu erzeugen.

DeepFocus – Facebooks KI-Rendering ab sofort als Open-Source-Software erhältlich

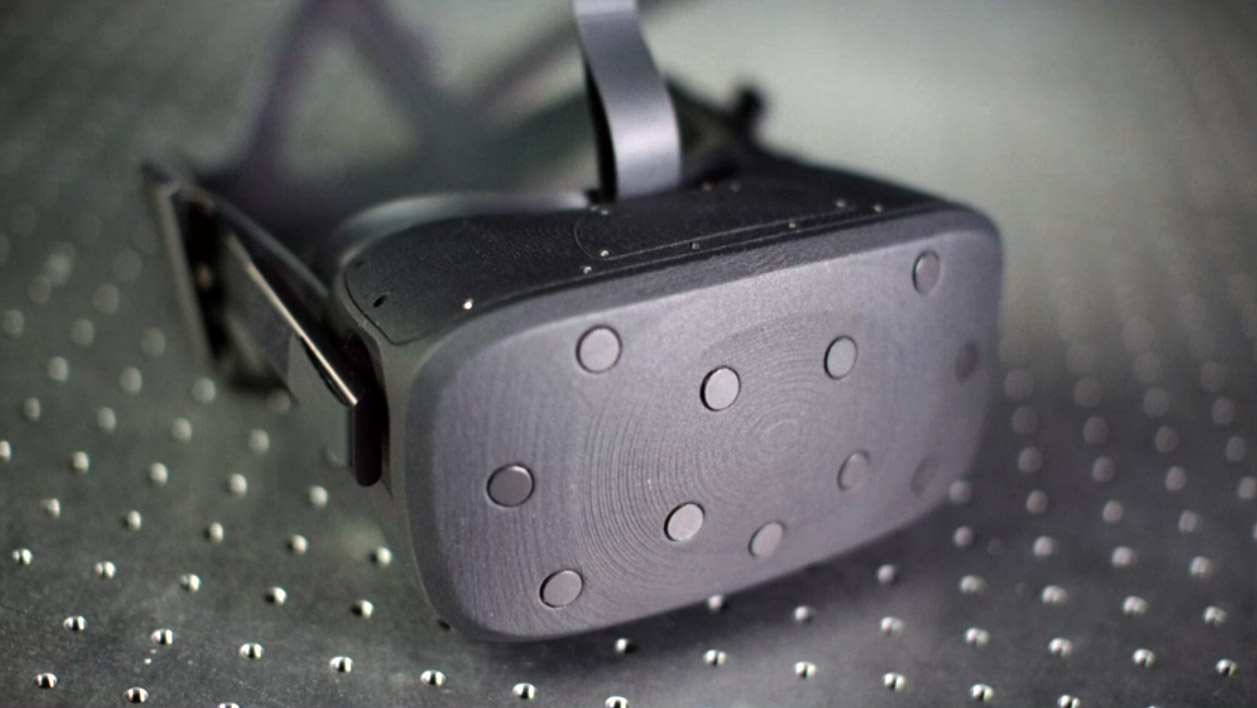

Bereits auf der diesjährigen Facebook-Entwicklerkonferenz F8 präsentierte das Unternehmen die Arbeit an einem eine neuen Prototyp namens Half Dome, welcher es erlaubt die verbauten Bildschirme mechanisch vor- und zurückzubewegen. Die Varifocal Displays sollen in den VR-Brillen der Zukunft verbaut werden, um verschiedene Fokusebenen innerhalb der VR zu erzeugen. Damit würden sie nach dem Vorbild des menschlichen Auges beispielsweise nahe Objekte scharf stellen, während weit entfernte Objekte in einer natürlichen Unschärfe dargestellt werden und umgekehrt.

Je nach Fokuspunkt und Blickrichtung soll also auch das Bild in Echtzeit angepasst werden, was für ein deutlich realistischeres und somit immersives VR-Erlebnis sorgt. Zudem schont es das menschliche Auge und sorgt damit für mehr Komfort innerhalb der virtuellen Umgebung.

Mit herkömmlichen Renderverfahren ist dies, softwareseitig, allerdings äußert schwierig umzusetzen, da diese nicht in der Lage sind, die nötigen Ergebnisse in komplexen Szenen schnell genug zu verarbeiten oder es zu Fehlern in der Darstellung kommt. Hier kommt das KI-Renderverfahren DeepFocus ins Spiel, das dank Deep Learning mit einem neuronalen Netzwerk bestehend aus 196.000 Bildern aus einem Szenenzufallsgenerator trainiert wurde. Dadurch ist es in der Lage, die 3D-Objekte innerhalb der komplexen Szenen genau zu erkennen, zu unterteilen und den Unschärfeeffekt entsprechend anzupassen.

Der Algorithmus erlaubt es also den künstlichen Unschärfeeffekt so realistisch in Echtzeit darzustellen, dass er den Nutzern gar nicht auffällt. Dies war ebenso das ursprüngliche Ziel der Forschergruppe, wie Marina Zannoli, eine der Entwicklerinnen, im Blog beschreibt:

“Unser Endziel ist es, visuelle Erlebnisse zu liefern, die sich nicht mehr von der Realität unterscheiden.”

Dennoch ist noch viel Entwicklungsarbeit nötig, um die Software auch zukünftig im Endkonsumentenmarkt einsetzen zu können. So ist derzeit noch ein extrem leistungsfähiges Setup mit vier Grafikkarten nötig, um DeepFocus mit dem Half-Dome-Prototyp einzusetzen, wie Forscher Salah Nouri, beschreibt:

“Wir konnten DeepFocus und Half Dome mit einem Setup mit vier Grafikkarten demonstrieren – ein signifikant leistungsfähigeres Setup als das, was Verbrauchern derzeit zur Verfügung steht […]. Dabei mussten wir sehr vorsichtig sein, wenn es darum ging, die Arbeit zwischen den vier GPUs zu parallelisieren, sodass die Speichertransfers zwischen ihnen so pipeliniert werden, dass sie keine zusätzliche Latenz erzeugen und praktisch keine Rechenleistung verursachen.”

Facebook veröffentlicht nun sein KI-Renderverfahren mitsamt dazugehörigem Code und den Daten aus dem neuronalen Training als Open-Source-Software und stellt sie damit frei für Devs zur Verfügung. Weitere Informationen sowie das veröffentlichte Paper auf der diesjährigen Entwicklerkonferenz SIGGRAPH Asia findet ihr hier.

(Quellen: Oculus Blog | Upload VR | Videos: Oculus YouTube)